殺人AIロボット開発阻止を訴え、ダボス会議で科学者ら

このニュースをシェア

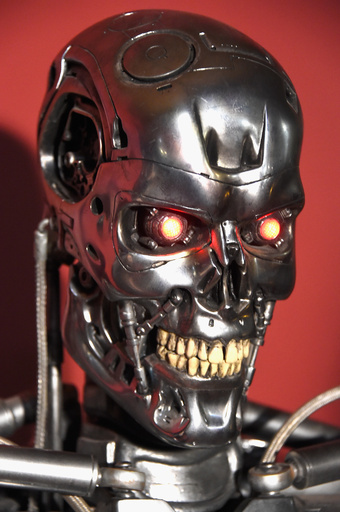

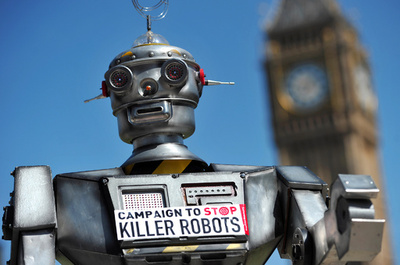

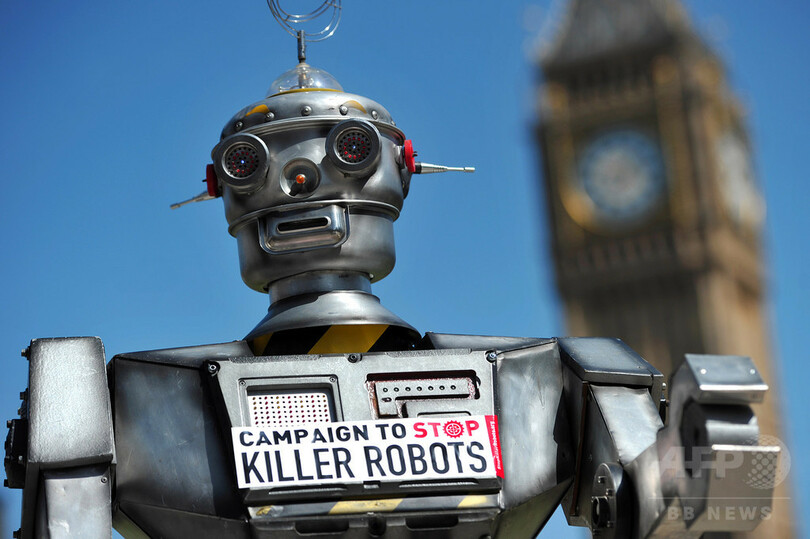

【1月23日 AFP】人工知能(AI)を備えた自律型ロボットが人間を殺しながら戦場をさまよう──そんな未来を回避するために世界は今すぐ行動する必要があると、「世界経済フォーラム(WEF)」年次総会(ダボス会議)に集った政財界の有力者や科学者、軍事専門家らが警鐘を鳴らした。

科学者らは自律型兵器の配備が、戦争行為の危険な新時代を象徴するようになると述べ、そうした兵器の開発を阻止するための合意が必要だと主張した。

米カリフォルニア大学バークレー校(University of California, Berkeley)のスチュアート・ラッセル(Stuart Russel)教授(コンピューター科学)は「われわれが話題にしているのは、人間のパイロットが操作する無人機のことではなく、自律型兵器のことだ。後方で操作する人は誰もいない。AI兵器、つまり人工知能兵器だ。非常に正確で、人間の介入なしに標的の位置を特定し、攻撃できる兵器だ」と語った。

昨年7月、英理論物理学者のスティーブン・ホーキング(Stephen Hawking)博士ら約1000人の科学者や技術者らは、自律型攻撃兵器の開発は、数十年ではなく、数年内に実現可能であるとし、その禁止を呼び掛ける公開書簡を発表した。書簡で科学者らは、世界がAI軍拡競争に陥る危険性や、そうした兵器が過激派の手に渡るリスクを警告した。

ダボス会議でラッセル教授はさらに「こうした機械が交戦規定に従うことができるだろうか」と問い掛けた上で、生物兵器が「ほぼ誰にでも」使用されるリスクがあったために米国が放棄したことを引き合いに出し「ロボットについても同じ流れになることを望む」と述べた。

西イングランド大学(University of the West of England)のアラン・ウィンフィールド(Alan Winfield)教授(電子工学)は、戦場での意思決定から人間を除外することが招くだろう深刻な結果を懸念し「それは人間から倫理的責任が奪われるということだ」と語った。またロボットの反応は予測しがたいとも付け加え「混沌(こんとん)とした状況の中にロボットを置けば、ロボットは無秩序に振る舞う」とも述べた。

英航空防衛機器大手「BAEシステムズ(BAE Systems)」のロジャー・カー(Roger Carr)会長もこれに同意し、「平和な時にせよ戦時にせよ、人間の営為から道徳や判断、倫理を除外してしまえば、人類はわれわれの理解を超える別のレベルに至ってしまう。同様に、正常に機能しなくなった際に、人間による制御メカニズムが利かない極めて破壊的になり得るものを戦場に投入してはならない」と述べた。(c)AFP/Michel SAILHAN